这篇文章将帮助您理解ChatGPT及其背后的复杂概念,包括Transformer、GPT、InstructGPT、大模型、AIGC等,用简单易懂的语言,让您轻松掌握这些技术的精髓。

想象一下,有一种高级的“翻译机器”,它不仅能理解和翻译不同语言的文本,还能捕捉到上下文关系,从而更准确地表达意思。这就是Transformer模型的工作原理。这个模型具备多种能力,如自注意力机制,它在阅读文本时不仅关注当前单词,还会记住并考虑整个句子或段落的其他单词;位置编码使模型理解单词在句子中的位置,这对理解句子结构至关重要;编码器和解码器分别负责理解输入文本和生成新句子;多头注意力机制让模型从多个角度理解文本;前馈神经网络则确保翻译的准确性和流畅性。

GPT模型的演变

GPT是一种基于Transformer架构的多层解码器,它像一位通过广泛阅读掌握多种语言和写作技巧的虚拟作家。GPT通过自监督学习,即在没有明确标注的情况下学习语言结构和用法。它首先进行预训练,积累大量知识,然后在特定任务上进行微调,以提高表现。每一代GPT都比前一代更强大,GPT-3尤其出色,即使没有或仅有少量示例,也能完成高质量的任务。

InstructGPT的作用

InstructGPT是对GPT-3的改进版本,旨在使其更好地理解和响应人类用户的意图。通过引入“对齐”(Alignment)概念,InstructGPT利用强化学习从人类反馈(RLHF)中学习,确保其生成的回答更加符合用户期望。这使得InstructGPT在对话中更加连贯、准确,减少了离题和编造的情况。

ChatGPT的功能与特点

ChatGPT类似于一个知识渊博的机器人图书管理员,能够帮助解答问题、提供信息,甚至理解图片内容。它不仅可以识别图片中的元素,还能根据图片讲述故事或回答相关问题。随着时间的推移,ChatGPT不断学习和进步,变得更加智能和有用。

大模型的概念及运作方式

大模型可以比喻为一个巨大的学校,拥有众多教师(参数)和学生(数据)。这个学校的设计独特,教师可以在不同教室教授各种课程,学生也能轻松切换教室。为了支持教学活动,学校配备了先进的计算机和服务器作为计算资源。此外,优化算法确保教学效果最佳,正则化技术防止过度专注某一课程,模型并行和数据并行则提高了教学效率。大模型培养了许多优秀的毕业生,如GPT-3、BERT和T5,它们在各自领域表现出色。

AIGC与扩散模型

AIGC是指人工智能生成内容,例如机器人朋友可以创作图画、编写故事或解答数学题。扩散模型则像将浑浊的水变回清澈的过程,从噪点中生成清晰图像。CLIP模型通过学习大量图片和名称,能够识别新图片中的对象。稳定扩散模型可以根据提示绘制特定场景,如“画一个快乐的小狗”。

AGI的愿景与挑战

通用人工智能(AGI)的目标是创建一个像人类一样理解世界的机器人,它不仅能完成特定任务,还能学习任何新技能。尽管目前的AI系统如GPT在某些领域表现出色,但距离真正的AGI还有很长的路要走。科学家们正致力于使AI更加智能,但这需要大量研究和技术突破。

大型语言模型(LLM)的潜力

大型语言模型像是一位博学的图书管理员,通过阅读大量书籍积累了丰富的语言知识。它可以执行多种任务,如文本总结、翻译和情感分析。模型内部有许多参数,帮助其记住和理解复杂的语言规则。GPT-3、ChatGPT、BERT和T5等模型各有专长,共同推动了自然语言处理技术的发展。

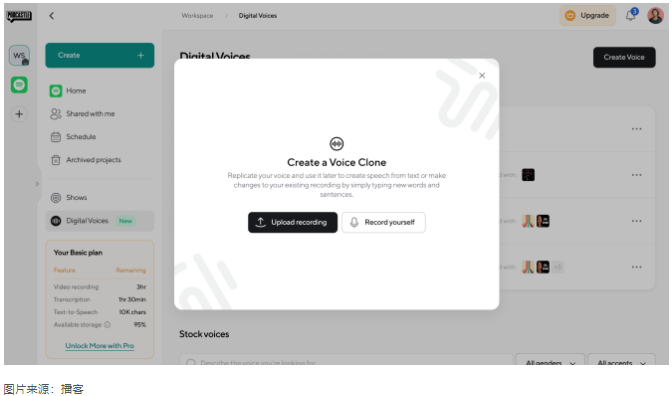

微调的意义与实践

微调是在已有技能基础上进行针对性训练,以更好地完成特定任务。例如,您已经学会了骑自行车,但想在山丘上骑行。您只需在山丘上进行几天的练习,学习如何应对上坡、下坡和弯道。这就像微调一个预训练模型,使其适应新的任务,如理解医学文本。微调节省了时间,因为它只需要调整已掌握的技能,而无需重新开始。

自监督学习的优势

自监督学习通过读故事和玩游戏来学习新单词,而不需要额外的标签或答案。例如,您在读故事时遮住一些单词,让朋友猜测下一个单词是什么。朋友可以通过上下文线索猜测正确答案。这种学习方式让模型在没有标注数据的情况下变得更聪明。

希望这篇文章能帮助您更好地理解ChatGPT及相关AI概念。如果您有任何疑问或想法,请随时留言讨论。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...